从前,我们都以为,亲眼看到的,亲耳听到的,不可能是假的,

但是在人工智能的时代,真的不好说了…

今年3月份的一个周五,一家德国能源公司英国分公司的总经理接到老板打来的电话,

老板直呼其名,催促他赶紧汇钱给匈牙利的供应商,不然公司要付违约金。

接着用邮件发来了对方的账号。

分公司的总经理刚开始有点懵,感觉事情仿佛哪里不太对劲。

但他之前跟老板通过好几次电话,对老板的声音很熟悉,这电话,他确定就是老板打来的,他独特的德国口音,停顿的习惯,音调,音色什么的,别人是模仿不来的… 不可能出错。

所以,虽然他心里还有疑惑,但他不敢违抗老板的命令。就按照邮件提示给匈牙利和墨西哥的几个账号汇去了22万欧元。

然而,过了一段时间,

老板再次来电,又让他汇款!

这…

是不是有问题啊?

他越想越奇怪,挂了电话后,决定直接打电话给老板问问。

这一打,老板也懵了:“我从来没有让你汇款啊!”

就在两人通话的时候,那个催促他汇款的“老板”再次来电。

当他意识到自己被骗了时,汇出国的那些钱早已被骗子取光。

报了警,找了保险公司,但是到现在,骗子也没被抓到…

为什么声音会那么像?

像到让熟悉的人都失去了警惕?

不怕骗子骗人,就怕骗子使用高科技啊!

骗子用的是人工智能的声音克隆软件。这种软件可以用A的声音片段,创造出A完全没说过的话。

过程很简单,输入一个人的声音后,软件会把声音分解为音色,音节等各个元素,然后重新组合成一个新句子。

这模拟出的新句子,会在语言表达方式,音调,语气上都跟原始声音差不多。

更可怕的是,这种技术并不难,

不需要太懂计算机,网上一搜就有很多现成的软件。

随着科技公司技术的提升,这种软件需要输入的原始素材量大大减少,做假的逼真度越来越高。

当然,这种技术现在还不是完美的,一个人在冷静的情况下基本上不太可能会被骗。

但技术不足的地方,骗子就会用骗术来弥补。

如果背后有噪音,声音有延迟,骗子可能会说自己正在电梯里,或自己正在赶着开车去机场。

并且通过各种方式给你造成一种压迫感,比如自称是你老板,或者设个很近的截止时间等等让你无法正常思考。

人工智能+专业骗术,很多高智商人士都逃不过被骗的命运…

前面说的这家德国能源公司并不是唯一的受害者。

网络安全公司的研究者已经发现了至少3起老总声音被克隆的诈骗案件。

其中一个案子,受害者被骗了数百万美元…

AI技术之下,耳听不一定为真,眼见也不一定为实了…

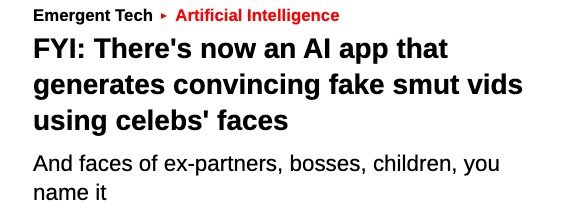

不仅可以模仿声音,还可以换脸。

小扎这视频,乍一看你能发现其实是假的吗?

更真的一点的,连口型都对的上…

这种技术,在给人带来便利的同时,也给一些心术不的人提供了作恶的武器。

明星的脸被嫁接到色情片中,甚至人们还开始担心有人会用AI换脸技术制作报复色情片…

视频可以做假,声音也可以克隆,以后到底还可以相信啥?

ref